Cover painting by Osman Hamdi Bey

Zeka insana has bir özellik. Yapay zeka (AI) ise, insanın geliştirdiği ve kendisine benzettiği yeni teknolojiye verdiğimiz ad. Bu güçlü teknolojiyi insan yarattığı gibi, yönetme sorumluluğuna da sahip.

Başlıkta Osman Hamdi Bey'in" Kaplumbağa Terbiyecisi" eserinden esinlendik. Bilinçli insanın, eğitemeyeceği bir şey olmayacağını çağrıştırıyor. Biz de yapay zekayı terbiye etme sorunluluğu olan kullanıcılarına, AI terbiyecisi diyoruz.

AI terbiyecisi olmak için teknoloji uzmanı olmanıza gerek yok. Herkesin kendi uzmanlığı ve konumuyla farklılaşan bir AI terbiye görevi olduğunu düşünüyoruz.

Herkesin farklılaşan görevlerini daha iyi anlatabilmek için örnekler ve öneriler hazırladık. Nedenler, Karar Destek Prensibi ve A.I. Terbiyecileri ile Yönetim.

1. Bölüm - Nedenler

Bugün görmeye alıştığımız genel AI çözümleri, algoritmik varsayımlar ne kadar başarılıysa o kadar başarılı analiz, tahmin ve otomasyon yapabiliyor. Ne kadar başarılı olursa olsun, hep göz önüne alınması gereken bir hata payına sahip.

Bir sonraki seviye olan üretken yapay zeka (GenAI), genel AI'dan farklı olarak algoritma varsayımları üzerine "hayaller" kuruyor. Makinenin hayalleri, insanın hayallerinden farklı ve denetlenmediğinde büyük gaflar yapabiliyor. (The biggest generative AI blunders of 2023)

Insansız Yapay Zeka Vakaları

Yeni ve sofistike çözümler son teknoloji olsa bile, insan için değer yaratmadığında kullanılmıyor.

Amazon'un 3 milyar $ dan fazla yatırım yaparak test ettiği insanız perakende GO yapay zeka çözümü ne kadar yetenekli olsa da, alışveriş karar noktalarında insana ihtiyaç duyduğumuzu ortaya çıkardı. (So, Amazon’s ‘AI-powered’ cashier-free shops use a lot of … humans. Here’s why that shouldn’t surprise you) Insanlar alışverişte zaman kaybetmek istemiyor. Ancak, satın aldığı ürün ve cebinden çıkan para ile ilgili kontrolü tamamen yapay zekaya devretmeyi sakıncalı buluyor.

Bir başka uyumsuzlukta, sürücüsüz arabalar konusu. Sürücüsüz kullanım teknolojik olarak mümkün olmaya yakın olsa da detaya indiğimizde, otonom arabaların bireysel kullanım beklentileri azalıyor. (Partially autonomous cars forecast to comprise 10% of new vehicle sales by 2030) İrrasyonel gözükse bile ,insanlar arabanın tüm kontrolünü yapay zekaya devretmek istemiyor olabilir. Bireysel kullanıcı, araba kullanmaktaki kontrol hissinden keyif alıyor. Öbür yandan, otonom sürüşün bireysel keyif olmadığı ticari kullanımda daha hızlı gelişmesinin daha hızlı olacağını düşünüyoruz.

Makine ile İnsan Tahmini

Yapay zekanın, insan davranışlarını tahmin etmekte hep bir hata payı olacaktır. Çünkü insan, çoğu zaman duygusal veya sebebini önceden anlayamayacağımız, irrasyonel kararlar verir. (Dan Ariely on 10 Irrational Human Behaviors) Makineden farklı olduğumuz bu insansı özellik bizleri hep özgün kılabilir. Yapay zekanın geleceği öngörebilmesindense, algoritmik varsayımlar yaptığını söylemek daha doğru olur.

Varsayımların gerçeklerle uyumsuzluğunun yaratabileceği sonuçları anlamak için gayrimenkul sektörünüden bir örnekle devam edelim.

Zillow, bir gayrimenkul teknolojisi şirketi. Ev fiyatlarını tahmin eden A.I. algoritmasındaki hata nedeniyle, evleri piyasa değerinden yüksek fiyatlarla satın alarak 2021’in üçüncü çeyrekte 304 milyon $ kayıp yaşadı.(Zillow’s home-buying debacle shows how hard it is to use AI to value real estate) Gayrimenkul teknolojisi stratejisti Mike DelPrete, Zillow'un yaşadığı sorunu özetliyor. "Gayrimenkul fiyatlamasını hata payı olmadan tahminlemek neredeyse imkansız. Çünkü konut satın almada mantıkla açıklaması zor, her insana göre değişen his ve davranışlar belirleyici oluyor."

Karar verme sorumluluğu insandan alındığında, yapay zekanın neden olduğu sorunların sayısı daha da artabilir.

Karar almayı destekler konumdaysa, sonuçlar daha olumlu.

2. Bölüm - Karar Destek Prensibi

Yapay zeka çözümü ne kadar sofistike olursa olsun, önceden belirlenmiş algoritma bazlı tahminlere dayanıyor. Karar almayı desteklediğinde, daha başarılı sonuçlar üretebiliyor. (Knowledge at Wharton - What Impact Will AI Have on Organizations? – Bob Meyer & Roger Gu | AI in Focus Series)

Amazon GO otonom market alışverişi başarısız olabilir. Ancak insanın karar almasını destekleyen fiziksel mağazalardaki jet kasalar veya çevrimiçi market alışverişi alternatifleri, insanların karar alma kontrolunu elinden almadan zaman kazanımı yaratarak orta yolu bulabiliyor. Bugün otonom sürüş bireyler için gerçek bir ihtiyaç olmayabilir. İnsanların uzaktan yönetebildiği otonom hareket edebilen nesneler, drone ve otonom ticari filo çözümleri ise gerçek bir talep.(Workinlot - Global Entrepreneurship Congress 2018 istanbul - Future of mobility workshop) Gayrimenkul fiyatlarının değerine yapay zekanın karar vermesi mantıklı değil ama insanın fiyatlama yapabilmesini destekleyen insan üstü veri tarama yetkinliklerini kullanmak mümkün. Chatbotların, müşterileri kritik konularda kararlarla yönlendirmesi sorunlar açabiliyor. Müşteriyi anlama, basit kararlarda kural bazlı yönlendirme ve kritik kararlarda yöneticilerine yönlendirme, başarıyla kullanılan bir orta yol.

Bulguyu destekleyen bir örnek de kendi alanımızdan. Büyük danışmanlık firmaları, danışmanlar karar verirken yapay zekayı nasıl konumlanması gerektiğini sorguluyor.

Harvard Business School ve BCG tarafından yapılan araştırma, GPT-4 AI kullanan danışmanların bir dizi görevde daha üretken ve verimli olabileceğini gösterdi.

Araştırmaya göre yapay zeka asistanı kullanan danışmanlar %12 daha fazla görevi %25 daha hızlı yapabildiler. Yeni işe giren danışmanların performansları %43 oranında artarken, deneyimli danışmanlarda da %17'lik bir iyileşme görüldü. (Harvard And BCG Unveil The Double-Edged Sword Of AI In The Workplace) Bu kazanımlarına rağmen, özellikle yaratıcı yapay zeka GenAI 'ın veriye erişimi olmasada varsayımlardan yola çıkarak verdiği hayali yanıtlar, danışmanların hata oranlarında ciddi bir artışa neden oldu. A.I. kullanan danışmanların hayali yanıtlardan dolayı yanlışlık olasılığı % 19 daha fazla oldu.

Araştırmanın sonucu, A.I. basit ama sayıca fazla karar noktasında doğru eğitildiğinde oldukça değerli.

Ancak karar almanın kritik olduğu noktalarda tek başına çok riskli. Kritik kararlarda insanın karmaşık ve bazen de rasyonelle açıklanamayan değerlendirme kapasitesi, rakipsiz.

Yapay zekayı karar destek için konumlayarak, insana hizmet edecek şekilde eğitebiliriz. Bunu yapabilmek için de nasıl yöneteceğimize de karar vermek gerekiyor.

3. Bölüm - A.I. Terbiyecileri ile Yönetim

Yapay zekanın kullanıldığı her farklı alanda, teknik olmayan uzmanlıklara da ihtiyaç var.

Bu uzmanlar, yapay zeka çözümünün kullanıcı ve çalışan için, etik, uygulanabilir ve güvenli olduğunu denetlemekle sorumlu.

Farklı uzmanlıklara sahip üyelerle, yapay zeka geliştirme ve yönetmeye uygun süreçler gerekiyor.

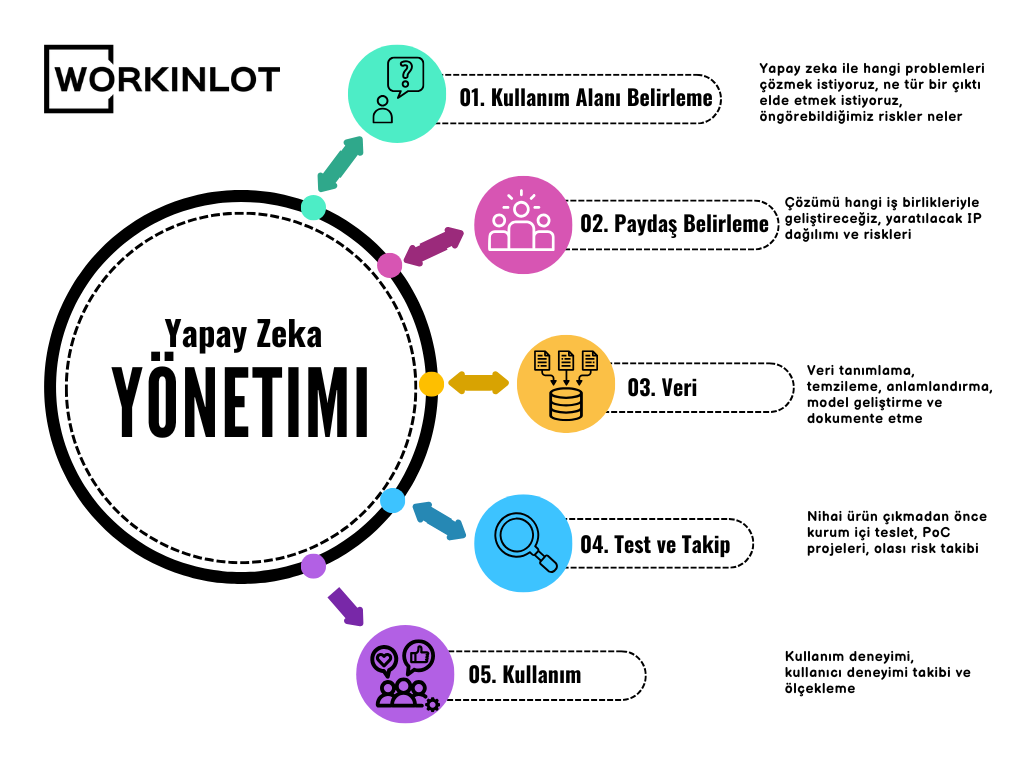

Bu süreç taslağını, yapay zeka yönetim görevlerini biraz daha somut yorumlayabilmek için geliştirdik.

- Kullanım alanı belirleme: Yapay zeka ile çözülecek problemleri listelemek, önceliklendirmek, çıktı beklentileri ve riskleri dokümente etmek

- Paydaş belirleme: Özgün bir algoritma veya hazır bir algoritma kullanımında iş birliği yapılacak kurum içi ve dışı paydaşların belirlenmesi, geliştirme süreç ve fikri mülkiyet haklarına yönelik beklentilerin belirlenmesi

- Veri: Çözüm geliştirmek için gerekli verinin tanımlanması, model geliştirme için hazırlanması ve dokümentasyon

- Test ve takip: Son kullanıma geçmeden önce PoC testlerinin yapılması, risk bulgularının adreslenmesi ve bir sonraki aşamada takip edilecek başarı metrikleri geliştirmek

- Kullanım: Son kullanıcı deneyiminin denetlenebilir ve raporlanabilir olması, ölçeklenme fırsatlarının değerlendirilmesi

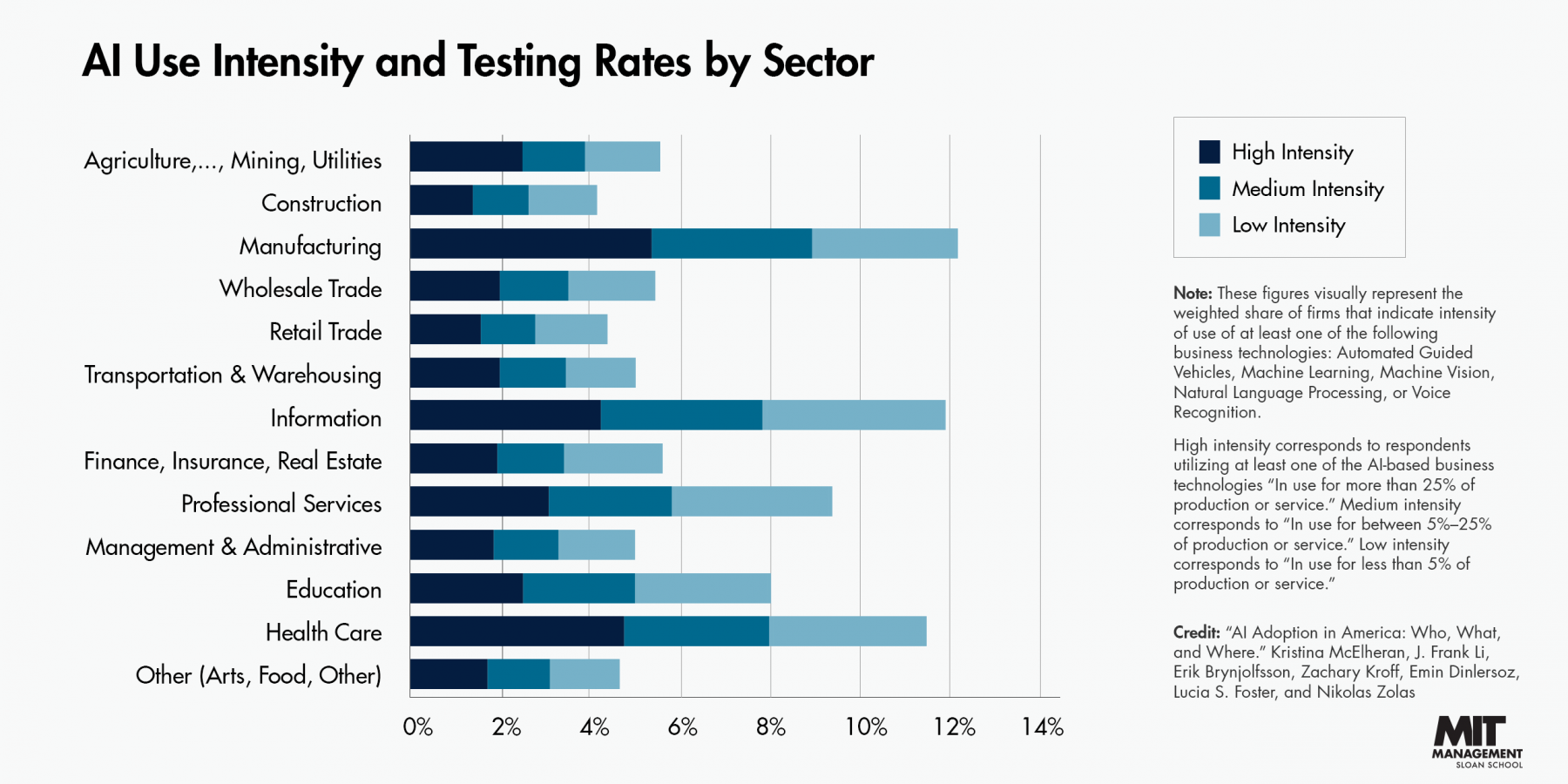

Yapay zeka yönetim hiyerarşisi ve süreçleri, kuruma göre farklılıklar gösterecektir. Ortak gerçek, kurumsal yapay zeka kullanımının giderek artan bir trende sahip olduğu.

MIT Sloan School of Management'in bir araştırmasına göre bugün, 5.000'den fazla çalışanı olan şirketlerin %50'sinden fazlası, 10.000'den fazla çalışanı olan şirketlerin ise %60'ından fazlası yapay zeka kullanıyor. (The who, what, and where of AI adoption in America)

Dijital çağda, veri yığınlarının arasında hareket edebilmek için çoğumuz yapay zeka çözümleriyle çalışmayı öğreniyoruz. Çalışarak eğittiğimiz yapay zekanın, insana hizmet etme hedefinden şaşmaması için, hepimizin farklı terbiye etme sorumlulukları var.

Önerimiz, şirketlerin yapay zekâ (teknoloji) yönetişim şemaları ve akışlarını geliştirmeleri. Bu hedefe yönelik, farklı uzmanlıklardan şirket çalışanları, yönetimin süreçlerinde yer alabilir.